ChatGPT王者归来了,这两天全世界都在刷GPT4o的图像功能。

确实太牛了。

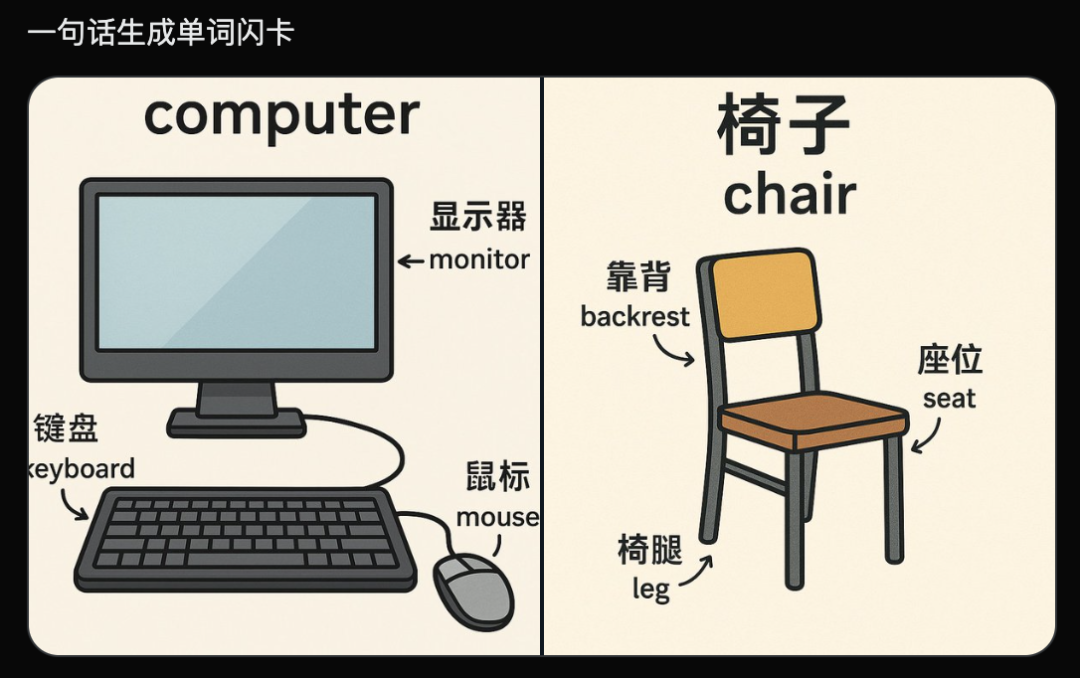

你可以一句话让它画出油画、线稿、像素风、设计图;可以让它改风格、加细节、重构场景——它的画图能力炫得像魔术。

各种设计师圈子、AI创业圈都热火朝天地测试,一边出效果图一边感叹:

"我一个小时调出来的图,GPT-4o十秒就给了三版,还比我好。"

但是,人人都在看它“画得多炫”,却忽略了它“看得多深”。

大家看到的是它能生成图像,但没看到它理解图像的方式已经发生了根本性的变化。

GPT-4o图像能力的本质,远不只是“画得好”,而是:

它拥有了比人类更强的图像理解能力,甚至能把图像变成可以讨论、推理和协作的语境。

它不仅能“看图”,它能看懂图要表达什么、看出图背后的结构与逻辑,甚至参与到你基于图像展开的任何任务之中。

素材来源于网络

这才是革命性的变化,也才是真正通向通用人工智能(AGI)的那扇门。

一、世界的底层语言是图像,而GPT曾经是盲的

我们一直以来把GPT当作一个“会写、会答题、能对话”的大语言模型,它能生成文案、代码、邮件、论文,改变了无数人的工作方式。

但我们忽略了一个事实:

这个世界的底层不是文本构成的,而是图像构成的。

语言是抽象的,是人类发明来描述世界的方式;但图像是直觉的、天然的,是生命最早掌握的沟通方式,是现实本身的投影。

- 婴儿不会说话,但能看图、看脸、看动作;

- 古人没有语言文字,但靠壁画和图腾记录世界;

即使到今天,图像仍然是跨语言、跨文化、跨智力层级的“通用语言”。

图像,是世界最本质的语言。

谁拥有理解图像的能力,谁就拥有理解现实的能力。

而直到GPT-4o之前,大模型都是“盲的”。它们再聪明,也无法直接理解图像中的世界结构、关系与意义。

GPT-4o,是第一个真正睁开“感知之眼”的通用模型。

二、GPT-4o不是多了“图像功能”,而是开启了视觉智能

GPT-4o不是在“会画图”,而是首次具备了看图、理解图、分析图、并与你交流图像意义的能力。它不再只是语言专家,而是开始成为一个现实世界的观察者与合作者。

素材来源于网络

它能理解你给它一张红外图时的意图,不只是识别里面有没有飞机,而是推断、标注、总结,再用自然语言告诉你结果和判断逻辑。

素材来源于网络

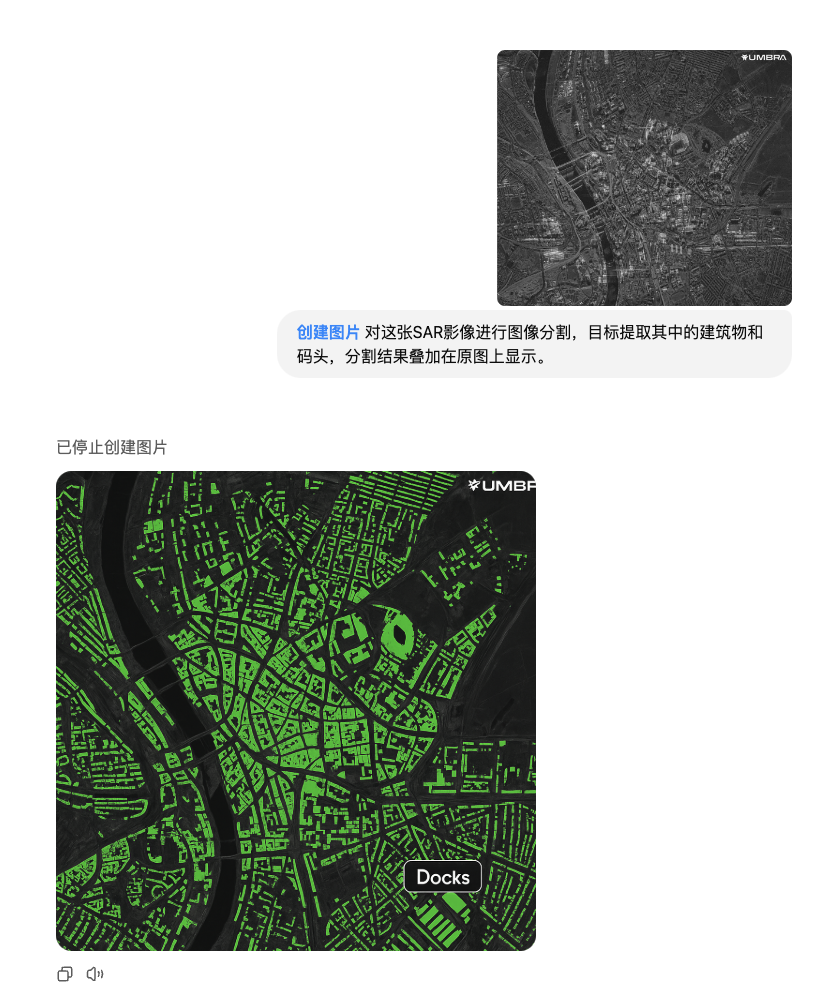

它能在SAR图像中找出建筑和码头,用视觉语言精确地“说出来”:哪里是城区,哪里是港口,为什么这么判断。

素材来源于网络

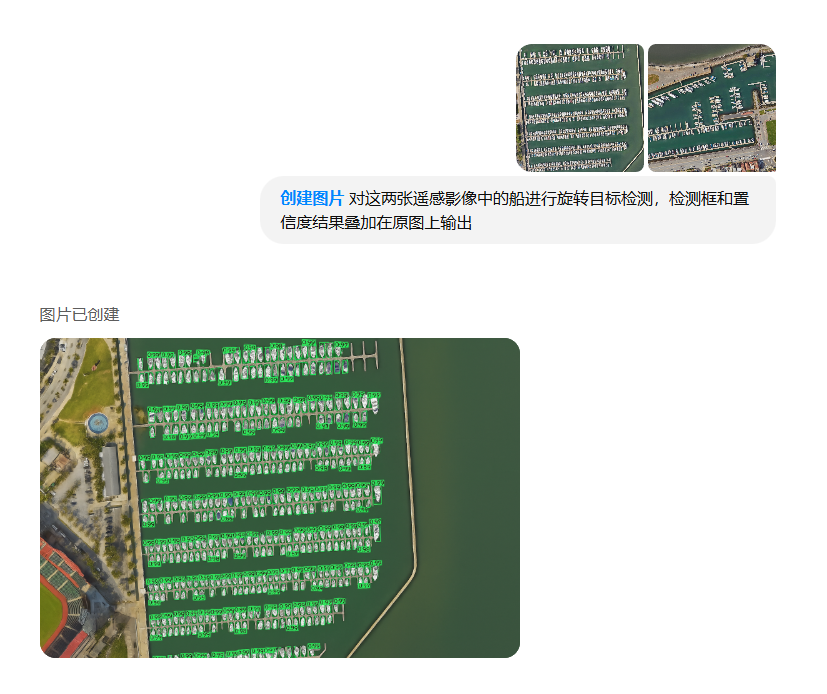

它能看懂密集船只的图像,并自动完成旋转检测、编号、归类、结构化输出,把一个复杂场景转化为可以讨论的数据资产。

素材来源于网络

它不是一张图识别几个目标的CV工具,而是一个能够理解你要“做什么”,并配合你完成视觉任务的智能体。

而且,它理解图像的方式,甚至比我们人类还要细致、结构化、即时可表达。

三、 GPT-4o正在重演一次视觉世界的NLP式革命

我们曾经见证了大语言模型如何颠覆NLP:

原本要靠分词、词性标注、情感分析、命名实体识别来做的事,现在一句prompt就能生成一篇完整文章。

现在,这件事正在视觉领域重演:

过去要用图像分割、目标检测、特征提取、超分辨、边缘检测、光流估计的流程,现在一句自然语言就能让GPT-4o直接完成整个视觉链路。

它用“输入需求 → 输出结构化结果”的方式,端到端覆盖了:

- 低级视觉任务(去噪、补全、超分)

- 中级任务(检测、分割、标注)

- 高级任务(视觉问答、推理、风格迁移、图像修复、场景生成)

从此不再有“这是CV任务、那是NLP任务”的界限,图像变成了一种新的对话语言。GPT-4o是第一个能“听你说”、“看你给的图”、“理解你要干嘛”、“再和你一起完成”的AI。

举几个你一听就懂的震撼场景

医疗

过去:医生看CT → 一帧帧对比 → 写报告

GPT-4o:你上传CT图,说“有没有异常”,它圈出疑点、说明判断逻辑、建议复查,并自动生成可视化结果。

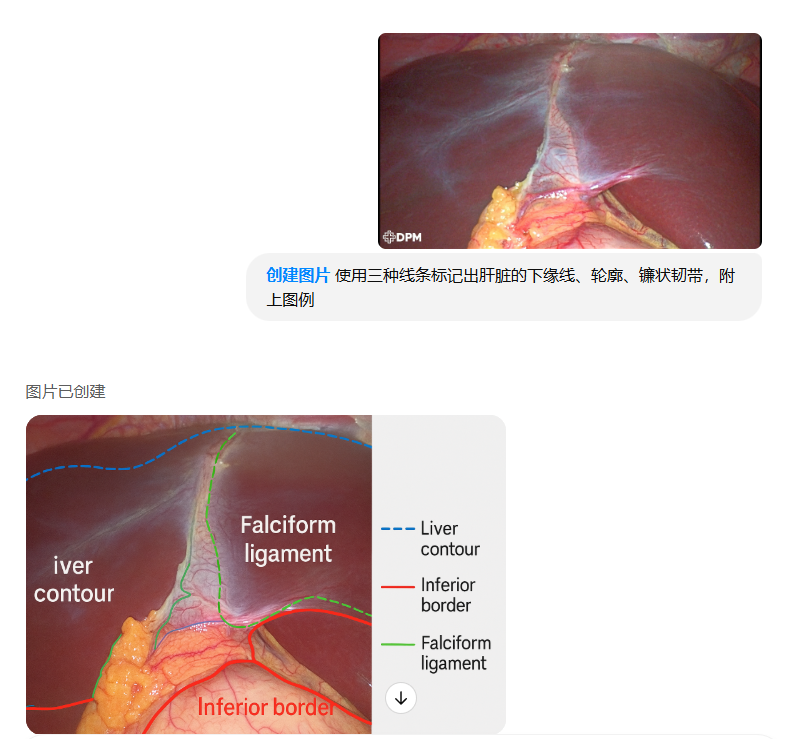

素材来源于网络

工业质检

过去:拍照 → 模型1识别缺陷 → 模型2标尺寸 → 模型3导出数据

GPT-4o:一句“这些零件有问题吗”,它直接输出编号+标注+诊断理由+检测报告。

公安监控

过去:人工翻监控,看帧图写笔录

GPT-4o:上传视频或监控图序列,说“有没有异常人员”,它直接告诉你:哪时哪人做了什么事,并配截图。

教育创作

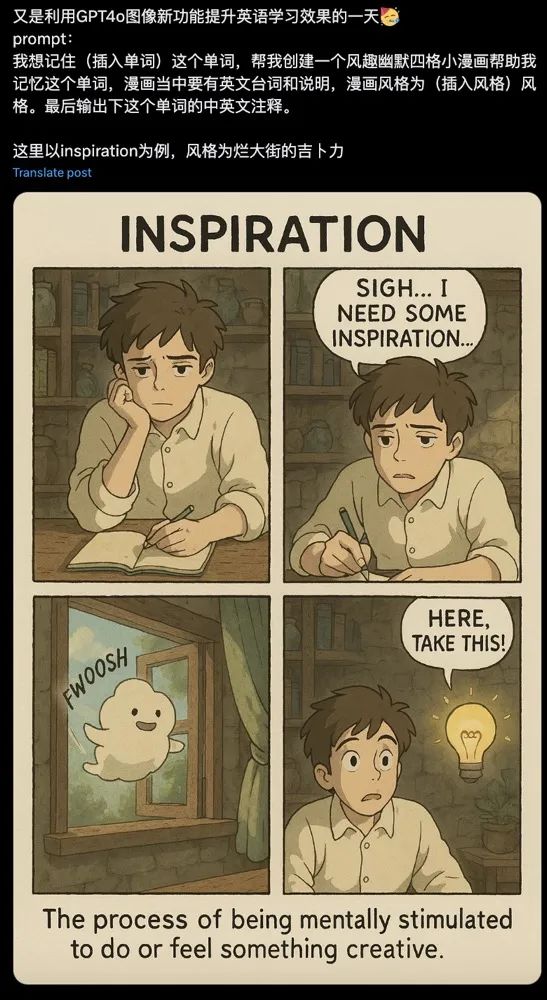

孩子画了一幅画,过去你得看半天才明白是什么,现在GPT-4o可以看着画帮你写出一个完整的故事,还能生成海报、配文案、编漫画。

素材来源于网络

四、GPT-4o不是“更好用”,而是让图像成为你能说话的对象

这不是“AI变强了”,而是AI能力的边界消失了。

GPT-4o不是帮你把图像处理流程做得更快,它是直接干掉了整个流程。

你不再需要:

会用OpenCV写边缘检测算法,

下载预训练模型跑图像分割,

手动标注上千张图训练缺陷检测,

研究SAR图的散射特性搞遥感分类。

你只需要一句话:

“这张图能不能拆出背景,换九种不同风格?

素材来源于网络

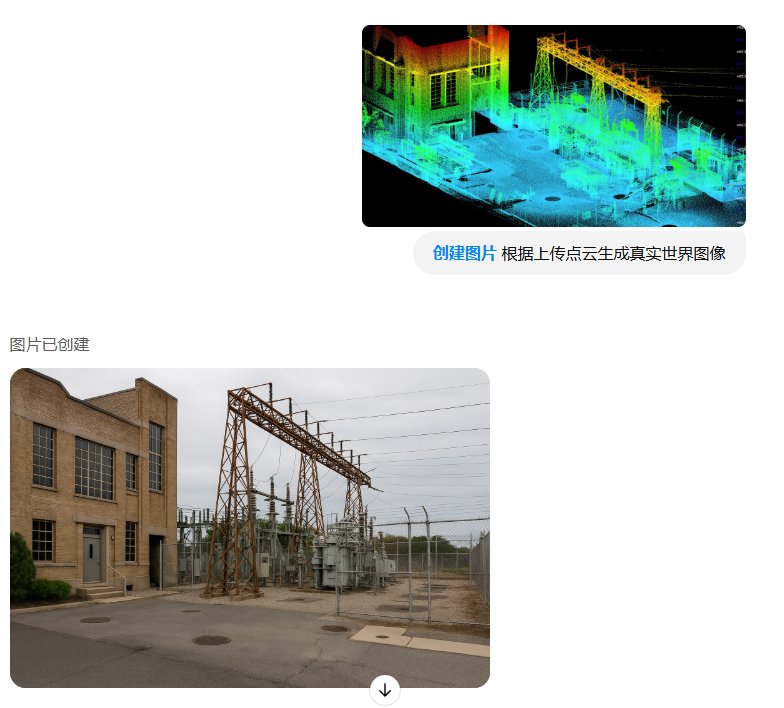

“根据上传点云生成真实世界图像。”

素材来源于网络

它就这么看懂了、理解了、做完了、还能用语言告诉你为什么这样做。就像你不再需要会SQL,只要问:“这个月的用户转化率是多少?”

未来你也不会再做图像分割、检测、修复,你只会说:“图上这些小点哪个可能是船?把它们方向标出来,并按密度分类。

而GPT-4o不仅能看懂、算出、标出,还能像人一样补一句:“看起来A区存在异常密度集中,可能是临时停靠点。”

这是一个完全不同层级的协作方式。

这不是“AI帮你处理图像”,而是你开始用语言操纵图像,像用语言操作文档、用语言操控数据一样。

图像,从“专业技能”变成了“通用语言” 。图像处理,从“技术任务”变成了“认知协作”。

这不是图像功能更强了,而是图像本身开始“听懂你说话”。

这就是图像语言时代的真正开启。

总结:GPT-4o视觉能力代表的不是进步,而是范式替换

它告诉我们:

世界是图像的,而AI终于“睁开了眼”。

这不只是一个模型的升级,而是整个认知边界的突破:

我们不再需要告诉AI“你该做什么”,它会理解;

我们不再需要构建模型链条,它会执行;

我们不再需要把图像转成数据,它直接在图像中“思考”。

GPT-4o不是图像工具,是视觉智能体。 它不再是“处理图片”,而是在用视觉和我们一起生活、工作、表达。

这不是AI看得更清楚了,是AI开始看得懂我们在看什么、为什么看、看完要干什么。

这才是图像能力真正的觉醒。我是朋克周,AI永不眠!

本文链接:https://www.xiaogua.cc/gpt-4o/86.html

gpt4o免费限制gpt4o免费版本gpt4o免费gpt4收费gpt4o免费多少次gpt4o免费用户gpt4o免费次数gpt4o免费额度gpt4o免费吗gpt4o免费用gpt4o免费开放